Tensorflow Research Cloud rozdaje dostęp do 1000 procesorów tensorowych TPU dla najlepszych naukowców na świecie. Dostałem 105 TPU z tej puli na 30dni.

Tensorflow Research Cloud

Tę wiadomość ortzymałem dziś z samego rana i bardzo się zdziwiłem i jednocześnie ucieszyłem. Dawno już zapomniałem, że wysłałemzgłoszenie do tego programu. A więc teraz potrzebuję/mogę przeskalować problemy, którymi się zajmuję do dość znacznych rozmiarów wykorzystując zasoby Google Cloud.

Procesory TPU v2

To jakiś obłęd obliczeniowy!

- Procesor TPU to 125 Teraflops mocy obliczeniowej i 64 GB szybkiej pamięci

- Mogę użyć ich aż 105 jednocześnie

- 5 przez cały miesiąc a 100 typu preemptible, które wynajmuje się na dzień i można zostać wywłaszczonym

- Można je programować z poziomu Tensorflow/Keras

Najnowsza obecnie karta z serii Nvidia Titan czyli Titan V posiada moc 110 Teraflops, więc niby różnica nie jest duża, ale pamięci jest tylko 12 GB, więc tyle samo co np. w Tesli K40/K80.

Plany

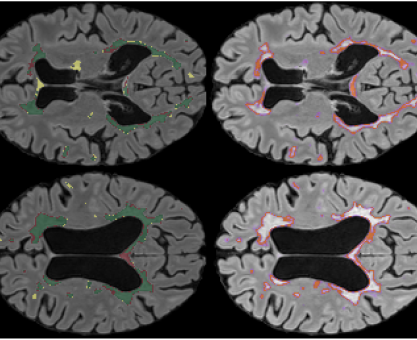

Będę walczył z uczeniem sieci neuronowych do wykrywania obiektów. Zacznę od uruchomienia treningu modeli z Tensorflow Model ZOO. Zaledwie kilka modeli jest przystosowanych do trenowania na TPU:

- SSD Mobilenet V1 0.75 depth COCO

- SSD Mobilenet V1 quantized COCO

- SSD Mobilenet V1 0.75 depth quantized COCO

- SSD Mobilenet V1 PPN COCO

- SSD Mobilenet V1 FPN COCO

- SSD ResNet 50 FPN COCO

Zacznę uruchamianie od SSD ResNet, jeśli nie zadziała to wrócę do pierwszego z gory modelu.

Bardzo mnie ciekawi czas obliczeń, coś mi podpowiada, że będę mógł dwa tygodnie zamienić na kilka godzin, więc znacznie skrócę iteracje.

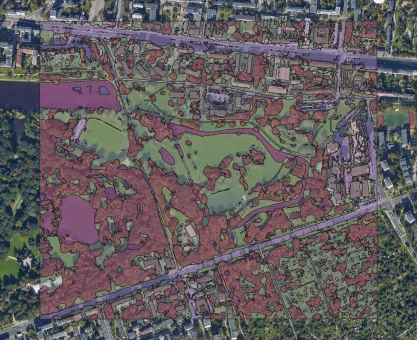

Przygotowuję zbiory danych, które wykorzystam do treningu, będzie to:

Planuję opisywać postępy prac tutaj oraz na moim VLOG’u na Youtube, także jeśli chcesz być na bieżąco, to koniecznie zasubskrybuj kanał.